一、引言

1) 背景

1. 人类检测的重要性

人类检测在多个领域具有重要应用,包括监控、自动驾驶、安防等。传统的视觉检测方法通常依赖摄像头进行图像处理,但这种方法在复杂环境下(如低光、遮挡和恶劣天气)可能会失效。高效且精准的人类检测不仅能提高系统的安全性与效率,也为智能化应用的实现提供了基础。

2. 传统视觉检测的局限性

传统视觉检测方法(如摄像头)虽然广泛应用,但却面临许多局限性。首先,视觉传感器在低光环境中表现不佳,遮挡物和隐私问题也影响检测效果。此外,恶劣天气条件(如雨雪、雾霾等)也会严重干扰图像质量,降低检测精度。

3. 毫米波雷达的优势

毫米波雷达(mmWave Radar)作为一种新型的传感技术,相比传统视觉传感器,具有不受光照影响、能够穿透非金属材料的优势。因此,毫米波雷达能够在复杂环境中稳定工作,包括低光、部分遮挡甚至恶劣天气下。它通过反射信号检测物体,获取其距离、速度和角度等信息,确保在环境条件不佳时依然能够提供高精度的检测。此外,毫米波雷达能够穿透墙体等非金属材料,这使得它在一些传统视觉传感器无法覆盖的场景中表现出色。

2) 挑战

1. 毫米波雷达点云的可视化困难

尽管毫米波雷达能够生成3D点云(包括x、y、z坐标),但这些点云数据的可视化存在困难。因为数据直观性差,难以有效理解实际的物体信息。

解决方案:为了解决毫米波雷达点云可视化的困难,作者将毫米波雷达的点云数据转换为2D雷达图像,并与相机视角对齐,增强了数据分析的直观性,也使得深度学习算法(如YOLOv9)能够更高效地处理和分析数据。

2. 稀疏与随机的雷达点云

人体作为镜面反射体,无法反射所有的毫米波信号,导致生成的毫米波雷达点云非常稀疏且随机。这种点云的稀疏性和周围环境强反射信号的干扰,使得从雷达数据中提取人体信息变得非常困难。

解决方案:作者使用了连续帧合成方法,结合多帧数据积累信息,增强了点云数据。此外,通过生物特征信息启用点选择方法,筛选出与人体相关的点,从而避免环境噪声的干扰。

3. 资源受限设备上的深度学习模型部署挑战

在资源受限的设备上,深度学习模型的部署面临着计算能力和内存的双重限制。

解决方案:为了在资源受限设备上有效部署深度学习模型,作者提出了深度互学习(DML)框架,通过对YOLOv9模型的压缩,使得轻量级的模型能够在保持高精度的同时,减小模型大小。

3) Preliminary

1. 毫米波信号的获取与特性

毫米波雷达技术利用毫米波波长的电磁波进行信息传输。文中采用的是一种常见的频率调制连续波(FMCW)毫米波雷达,该雷达能够通过捕捉反射信号,估算目标的三维点云以及其距离、速度和角度等信息。

特性:

- 稀疏性:与视觉数据不同,毫米波信号只会反射部分人体表面,导致生成的点云相对稀疏。

- 噪声:由于多路径反射,毫米波雷达容易受到来自环境的干扰,增加了噪声。

- 低空间分辨率:毫米波雷达的角度分辨率较低,无法像视觉图像那样精确地捕捉目标细节。

这些特性使得毫米波雷达在目标检测过程中面临一些挑战,但其在低光环境和复杂场景下的优势非常明显。

2. MVDR波束成形

为了提高角度分辨率,文中使用了最小方差无畸变响应(MVDR)波束成形算法。MVDR波束成形通过调整天线阵列的权重,最小化输出功率,同时保持来自目标方向的信号无畸变。

作用:

- 提高角度分辨率:通过优化天线阵列的权重,MVDR能够生成更锐利的波束,帮助区分来自不同方向的信号。

- 噪声抑制:MVDR波束成形不仅可以提高分辨率,还能有效抑制来自其他方向的噪声和干扰。

这种方法在毫米波雷达信号的应用中,特别适用于提高目标检测的精度和可靠性。

3. YOLOv9目标检测网络

YOLOv9是一种最近推出的目标检测网络,特别适用于速度和精度之间的平衡。在文中,YOLOv9被用作目标检测的骨干网络,用来处理毫米波雷达生成的图像。

特性:

- 高效和精度的平衡:YOLOv9使用编程梯度信息(PGI)来优化网络,以适应不同的目标检测任务。

- 高效推理:YOLOv9采用了高效的层级聚合网络(GELAN)作为骨干结构,显著提高了推理速度并减少了计算负担。

在毫米波雷达图像的目标检测中,YOLOv9的应用使得系统能够高效地识别和定位人体目标。

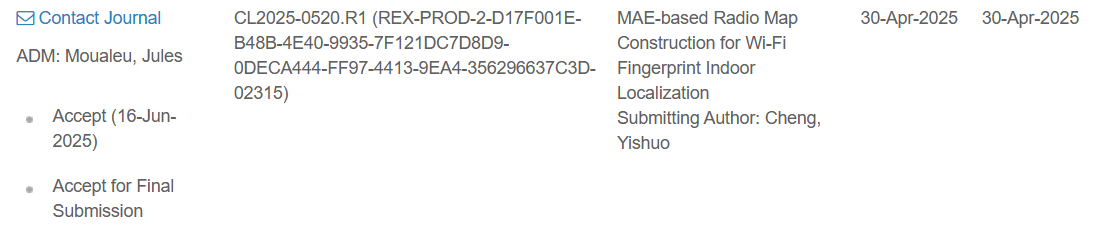

二、mmYodar+

1) Overview

1. 点云生成 — Point Cloud Generation

- 使用 Range-FFT 与 MVDR 波束成形 来定位潜在的人类目标。

- 采用 仿生过滤(Bio-inspired Filtering)去除环境噪声,仅保留人体反射点。

2. 人体感知 — Human Perception

- Radar-Camera Point Projection(雷达-相机点投影):将雷达数据映射到相机图像空间。

- Frame Composition(帧合成):通过合成多帧数据,增强点云信息。

- Expansion with Color(颜色扩展):在角分辨率较低时,扩展点云并引入颜色来增强人体轮廓。

3. 人类检测系统 — Human Detection System

- 引入 DML(Deep Mutual Learning)框架,通过轻量级的 YOLOv9 模型进行人体检测。

- 在训练阶段,使用 RGB 图像 进行跨模态学习,在推理阶段只需要雷达数据即可进行人体检测。

2) Human Perception From mmWave Signals

候选范围箱估计

距离单元扩展 — Range Bin Expansion

- Range-FFT(距离快速傅里叶变换)将毫米波信号转换为距离信息,并生成热力图(Heatmap)。

- MVDR波束成形:在-45°到+45°的范围内进行扫描,步长为1°,用于提高雷达系统的角度分辨率。

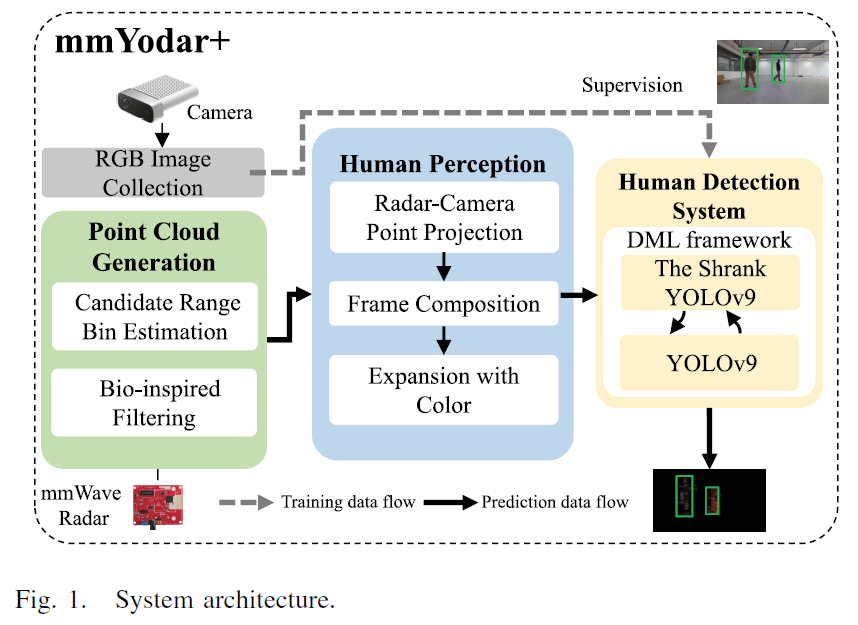

- CFAR检测:在噪声环境下进行目标检测,通过CFAR方法消除不必要的噪声和干扰。

- 距离单元扩展:扩展距离单元,检测并加强与人体相关的反射点。

如图所示,若多个目标距离相近,或者多个CFAR检测到多个峰值时,扩展后的区域可能会发生重叠,从而导致错误的目标检测。

- 图(a)显示了初始的 RA 热力图,代表雷达收集到的初始信号。

- 图(b)展示了通过 CFAR 方法处理后的热力图,成功识别了目标峰值并消除了背景噪声。

- 图(c)展示了在 CFAR 检测后扩展的范围单元,这一过程有助于增强目标识别。

通过这样的处理过程,毫米波雷达信号的准确性得到显著提高,使得目标检测更为精准。

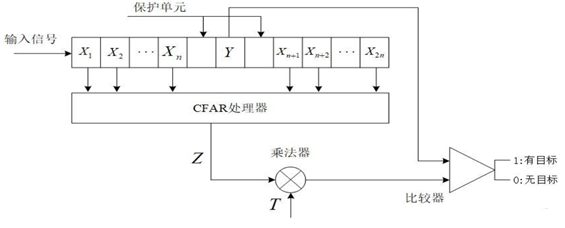

2. CA-CFAR原理解释

CA-CFAR(Cell Averaging Constant False Alarm Rate)是一种在不同噪声水平下自适应检测目标峰值的方法。在雷达检测中,目标峰值往往被噪声干扰,CA-CFAR 通过设置 训练单元(Training Cells)和 保护单元(Guard Cells)来抑制噪声干扰。

- 训练单元(Training Cells):用于估计背景噪声。

- 保护单元(Guard Cells):用于防止目标附近的噪声干扰。

在噪声较为平稳的情况下,CA-CFAR能够有效检测到目标峰值。如果目标距离较近或多个CFAR检测到多个峰值,可能会导致区域重叠,从而影响检测精度。

生物特征过滤

问题描述:在 距离单元扩展 过程中,多个目标距离较近或多个 CFAR 方法检测到多个峰值时,扩展后的区域可能会发生 重叠,从而影响目标检测精度。

解决方案:为解决该问题,作者引入了 生物特征过滤,通过筛选与人体相关的反射点,减少环境噪声和非目标物体的干扰。

工作原理:生物特征过滤模拟生物体的感知机制,利用人体的雷达反射信号筛选点云数据,只保留与人体特征相关的信号,去除不相关的噪声和物体。

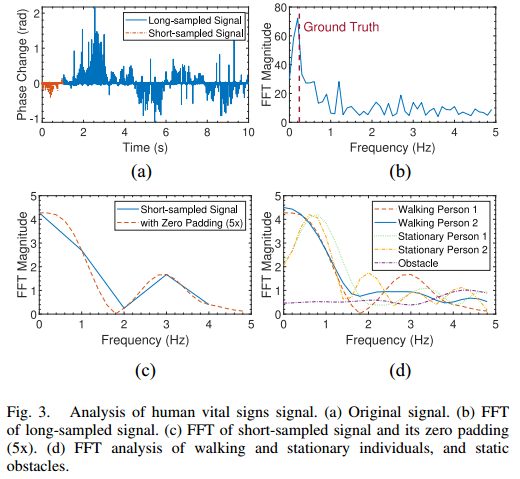

效果:生物特征过滤提高了雷达系统在复杂环境下的目标检测精度,尤其是在目标密集或复杂背景下,如 图 3(d) 所示。

1.频谱泄漏现象:使用 FFT 频谱分析时,信号的频谱并非真实的频谱,而是一个模糊版本,频率成分会泄漏到邻近频率。这种现象在有限长度和非周期信号中尤为明显。

图 3(a): 长时间采样信号的相位变化(蓝色)与短时间采样信号的相位变化(橙色)对比。

图 3(b) 和图 3(c): 对应的 FFT 结果 展示了长时间采样的主频分量与短时间信号频谱泄漏的对比。

解决方案:为了增强短时间信号的分辨率,本文对短时间信号应用了 五倍零填充(Zero Padding)。这样做可以更好地捕获感知信号的真实频率,如 图 3(c) 所示,零填充有效地减少了频谱泄漏现象。

2.生物特征信号提取:为了有效提取生物特征信号,本文关注 0-2 Hz 范围内的频率成分,这是呼吸频率的典型范围。通过分析频率峰值,如果该峰值落在 0-2 Hz 范围内,并且其值为 0-5 Hz 范围内平均值的三倍以上,则认为它匹配人体频率。

| 生理信号 | 频率范围 | 典型值(健康成人) |

|---|---|---|

| 呼吸频率 | 0.2 – 0.3 Hz | 约 12 – 18 次/分钟 |

| 心跳频率 | 1 – 1.67 Hz | 约 60 – 100 次/分钟 |

3.最终范围箱集的定义:在生物特征分析后,本文将得到最终的范围箱集 C,定义为:

\( C = \{i \delta(F_i) \{R_i\}_n \} \)

其中,δ(Fi) 是二进制生物特征滤波函数,定义为:如果集合 {Ri}_n 中的任何 Ri 匹配人体频率,则 δ(Fi) = 1,否则为 0。

如 图 3(d) 所示,无论人体目标是移动还是静止,其 FFT 信号 都会比静态障碍物的信号具有明显的能量峰值。这一生物特征滤波器显著增强了系统准确识别人体目标的能力,同时有效排除了来自静态障碍物的误报(假阳性,FP)。

验证:通过这一生物特征滤波器,本文能够有效过滤掉 CFAR 检测到的错误范围单元,如 图 2(d) 所示,这个方法验证了其在实际应用中的有效性。

生成点云

问题描述:在获取生物特征过滤后的目标范围单元后,本文继续进行 点云生成。具体来说,在 Range-FFT 之后,给定一个包含 N 帧的时间域毫米波雷达信号 \( S = \{S_1, S_2, \dots, S_N\} \),每一帧的去噪处理如下:

\( H S_i = H S_i – H S \)

这里,\( H S_i \) 表示第 \( i \) 帧的 Range-FFT 热力图,而 \( H S \) 表示沿速度维度的平均热力图。

接下来,本文执行 Doppler-FFT 和 Angle-FFT,这些是生成点云的基础步骤。

传统方法的局限:以往的 点云生成方法通常通过依赖 反射强度 来生成点云,通常选择信号强度最高的固定数量的点,或者选择超出能量阈值的点。然而,这种方法存在以下两个主要问题:

- 信号强度较低的目标点可能会被忽视,尤其是那些位于更远距离或不同角度的目标。

- 能量阈值方法容易受到噪声的干扰,这可能导致 假警报 或 漏检。

改进的方法:为了避免以上问题,本文的方法在生成点云时不仅仅依赖于能量阈值或固定数量的点,而是考虑了每个目标的 反射强度。通过这种方式,基于每个估算目标范围单元的 灵活 3D 点云生成 方式得以实现。

1.目标范围单元的选择:由于目标的范围单元数量可能不同,本文通过以下公式来确定选取的目标数量 \( P_n \):

\( P_n = \min(64, 10 R_n) \)

其中,\( R_n \) 表示目标范围单元的数量。如果目标跨越了多个范围单元,则可能涉及多个目标,因此需要更多的点(即 \( 10 R_n \))来准确表示该目标。经验观察表明,64 个点足以表示一个目标,因此最大值被设置为 64。

选定的 \( P_n \) 值随后用于生成 3D 点云。

优势:与传统的基于能量阈值的点选择方法相比,这种方法更加灵活,因为不同场景(例如直视或遮挡场景)中的能量水平差异较大,因此基于反射强度的点云生成方法能显著提高精度。

2.点云生成与目标表示:通过计算每个点的 (x, y, z) 坐标,本文构建了 3D 点云。每一帧生成一系列 3D 点,每个点由一个 6D 向量 表示,包含以下内容:

- 三个坐标 \( (x, y, z) \)

- 距离 \( r \)

- 速度 \( v \)

- 接收到的信号强度 \( rss \)

通过这种方法,雷达系统能够生成更准确的点云,帮助系统精确识别目标并有效应对复杂环境。

3) 2-D Imagery of Point Clouds

问题描述:毫米波雷达的宽带宽和高工作频率使其成为估计人体存在的强大工具。通过波束形成定位人体位置,并通过生物特征分析来细化检测,本文可以获得一系列对应人体的 3D 点云。然而,直接使用 3D 点云 或 范围-角度(RA)热力图 进行检测存在一些局限性。

解决方案:为了克服这些局限性,本文采用了一种 2-D 转换策略,将 3D 雷达点云 转换为类似图像的表示形式。这样做具有几个关键优势:

- 空间对齐:转换后的 2D 雷达图像 与相机视角空间对齐,使其与基于视觉的检测框架兼容。

- 简化训练:这种对齐使得本文能够使用现有的图像注释进行有监督训练,简化了雷达检测系统的开发。

- 利用标准图像检测器:通过与视觉系统兼容,本文可以利用标准图像检测器来进行训练,进一步提高系统的效率。

雷达-相机点投影

问题描述:为了检测人体并在 2D 边界框中表示其空间位置,本文需要建立一个初始 3D 毫米波点云 和相机拍摄的 2D 图像 之间的关联。具体而言,给定一个雷达点 \( (x, y, z) \),本文将其映射到 2D 像素坐标:

\[ \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} = \frac{1}{z} K T \begin{bmatrix} x \\ y \\ z \\ 1 \end{bmatrix} \]

其中,\( K \) 是 相机内参矩阵,\( T \) 是 相机外参矩阵,\( (x, y, z) \) 是在雷达坐标系统中的 3D 位置,\( (u, v) \) 是对应的 2D 像素位置。

内参矩阵 \( K \) 和外参矩阵 \( T \):

\[ K = \begin{bmatrix} f_x & 0 & c_x \\ 0 & f_y & c_y \\ 0 & 0 & 1 \end{bmatrix} \quad T = \begin{bmatrix} r_{11} & r_{12} & r_{13} & t_x \\ r_{21} & r_{22} & r_{23} & t_y \\ r_{31} & r_{32} & r_{33} & t_z \end{bmatrix} \]

其中,\( K \) 是相机的内参矩阵,包含焦距 \( f_x, f_y \) 和主点坐标 \( c_x, c_y \);\( T \) 是相机外参矩阵,包含旋转矩阵 \( r_{ij} \) 和位移 \( t_x, t_y, t_z \)。

频谱变化:通过上述映射,本文能够将雷达点云中的 3D 坐标精确转换到相机坐标系,从而获取 2D 图像中的对应像素位置。这种映射过程对于 目标检测 至关重要。

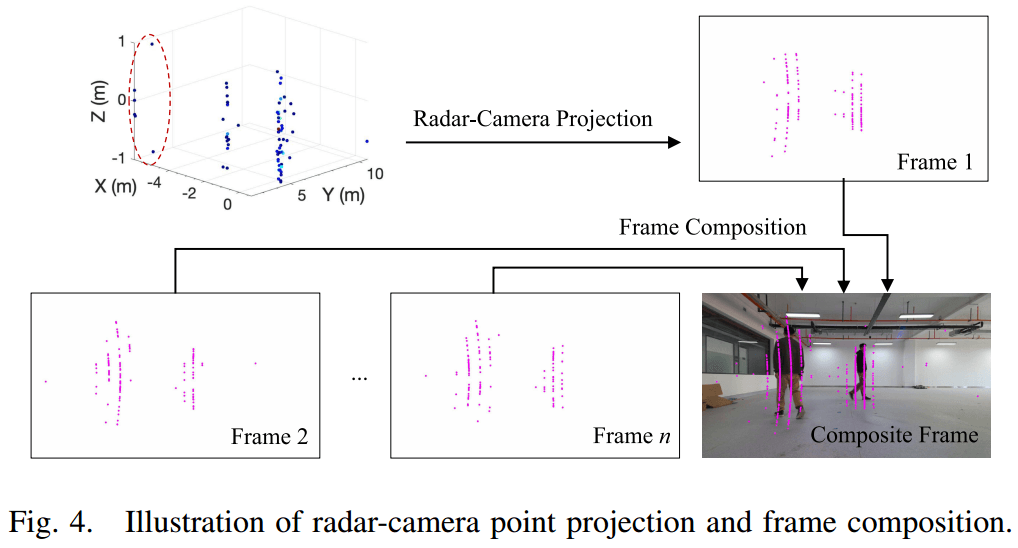

例如,通过这种映射方法,图像中的人体目标可以在相机视角中被标记和识别。特别是当一些点(例如来自墙面的反射点)超出相机视场时,本文可以在映射过程中将这些点(用红色虚线圈出)去除,如图 4。

验证:这种投影方法有效地去除了墙面反射等 虚拟反射,从而提高了检测精度。

在此过程中,本文使用以下公式进一步定义 2D 图像和 3D 雷达点之间的转换:

\[ \begin{bmatrix} u \\ v \end{bmatrix} = \begin{bmatrix} \frac{f_x x’}{z’} + c_x \\ \frac{f_y y’}{z’} + c_y \end{bmatrix} \]

\[ \begin{bmatrix} x’ \\ y’ \\ z’ \end{bmatrix} = T \begin{bmatrix} x \\ y \\ z \\ 1 \end{bmatrix} \]

其中,\( x’, y’, z’ \) 是映射到相机坐标系后的雷达点云坐标,\( u, v \) 是映射后的 2D 图像坐标。

帧合成

问题描述:人体作为镜面反射体,像镜子一样反射毫米波信号,而不是将其散射开来。因此,雷达检测到的反射信号会根据每个肢体的表面朝向而变化,导致反射信号可能稀疏且不均匀。特别是那些将信号引导远离雷达的肢体,可能会变得难以检测。图 4 展示了通过连续 \( n \) 帧收集的点云数据。从图中可以看到,随着人体行走,每一帧的反射信号是随机的且稀疏的。

解决方案:为了捕捉足够的点云信息,以便进行准确的人体特征分析,本文采用了 多帧合成 方法。具体来说,本文收集连续七帧毫米波点云,并将它们合成到一个图像中。

这七帧覆盖了 0.35 秒的时间段,在此期间,人体几乎保持静止,导致点云几乎同时收集。如图 4 所示,合成后的帧包含了更多的信息,更能准确地匹配图像中人体的实际外观。

验证:通过合成多个帧,本文能够有效增加目标的检测精度,并克服反射信号的稀疏性问题。这使得系统在动态环境中能够更可靠地进行目标检测。

颜色扩展

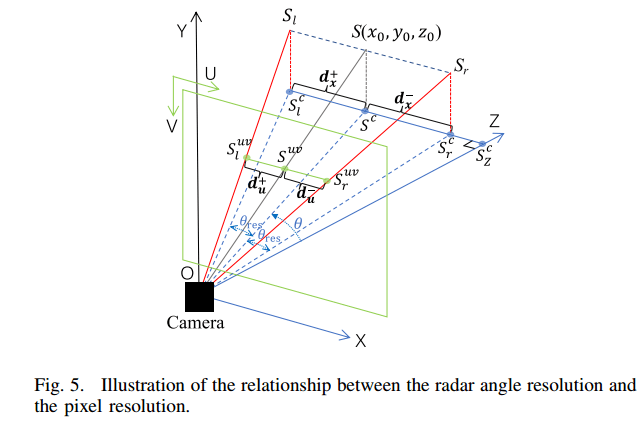

问题描述:与相机相比,毫米波雷达的角度分辨率较差。理论上,角度分辨率 \( \theta_{res} \) 由以下公式确定:

\[ \theta_{res} = \frac{\lambda}{N l \cos \theta} \]

其中,\( \lambda \) 是波长,\( N \) 是虚拟天线的数量,\( l \) 是两个接收天线之间的距离,\( \theta \) 是目标的到达角度(AoA)。公式(10)告诉本文,随着到达角度 \( \theta \) 偏离 0°,角度分辨率 \( \theta_{res} \) 会增加,这意味着来自大方位角的目标反射会更加稀疏且不准确。

为了应对这一限制,本文沿着方位角方向扩展点云(考虑到人体的高度是有限的,且在帧合成后容易捕获,本文只沿方位角方向扩展点云)。

解决方案:如图 5 所示,设 \( S(x_0, y_0, z_0) \) 为接收到的雷达点(已通过公式(9)投影到相机的世界坐标系中),其到达角度为 \( \theta \)。由于毫米波雷达的角度分辨率较差,根据公式(10),实际的投影可能是 \( S^c_l \) 或 \( S^c_r \),特别是在极端情况下。通过计算正方向距离 \( d^+_x \) 和负方向距离 \( d^-_x \),本文可以表示为:

\[ d^+_x = z_0 \left( \tan(\angle S^c_ZOS^c_l) – \tan(\angle S^c_ZOS^c) \right) \]

\[ d^-_x = z_0 \left( \tan(\angle S^c_ZOS^c) – \tan(\angle S^c_ZOS^c_r) \right) \]

然后,可以使用以下公式表示 UV 平面中的距离分辨率:

\[ d^+_u = \left| |S^{uv} – S^{uv}_l| \right| = f_x \frac{d^+_x}{z_0} = f_x \left( \tan(\theta + \theta_{res}) – \tan(\theta) \right) \]

\[ d^-_u = \left| |S^{uv} – S^{uv}_r| \right| = f_x \frac{d^-_x}{z_0} = f_x \left( \tan(\theta) – \tan(\theta – \theta_{res}) \right) \]

如上述公式所示,具有相同角度的点在 U 方向 上表现出等效的误差,这表明可以使用 U 方向的分辨率 来确定适当的扩展范围,从而涵盖整个身体。

扩展方法:根据经验,本文将每个点沿正方向和负方向扩展,分别扩展 \( \frac{d^+_u}{2} \) 和 \( \frac{d^-_u}{2} \),从而包围整个人体。本文还将每个点的 范围 \( r \)、速度 \( v \) 和 重叠率 \( \alpha \) 作为 RGB 通道,并通过颜色进行扩展。

重叠率 \( \alpha \):重叠率 \( \alpha \) 被定义为扩展后覆盖当前像素的总点数(\( N \))的比率,范围为 [0, 1]。当 \( N \) 大于 15 时,设置 \( \alpha = 1 \),表示在周围区域内密集的雷达点。

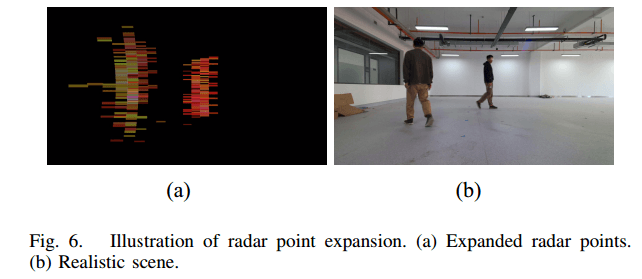

示例:在图 6(a) 中展示了扩展后的点云,可以看到扩展后的点云接近人体轮廓,并与实际图像(图 6(b))的外观更为一致。

4) Deep Learning Model

跨模态监督

问题描述:在毫米波信号的目标检测中,一个关键的挑战是 标注数据的稀缺性。与视觉数据不同,射频(RF)信号复杂且难以准确标注。

解决方案:为了解决这一问题,mmYodar+采用了一个统一的框架,该框架以 投影后的雷达图像 作为输入,预测图像坐标系中的目标位置。该方法通过利用已经建立的视觉模型,可以轻松生成同步的标签。在本文的实现中,本文同时收集 毫米波信号 和 RGB 图像,并使用 YOLOv5 生成图像上的边界框和标签。这一 跨模态监督 方法使本文能够有效地训练深度神经网络(DNN)模型,并取得准确的目标检测结果。

优势:该方法通过利用视觉数据提供的准确标签,来指导毫米波雷达信号的检测,提高了训练效率并显著提升了检测精度。

- 跨模态监督 方法利用视觉模型生成的标签来指导雷达信号的目标检测。

- 该方法解决了 毫米波信号标注困难 的问题,提高了深度神经网络的训练效果。

- 通过 YOLOv5 模型的应用,成功实现了 目标检测 的准确性提升。

基于深度交互学习的框架

背景:目前,在计算机视觉领域,已经开发了大量的目标检测网络,其中 YOLOv9 因其高性能、快速速度和较低的计算负载而受到广泛使用。因此,本文采用 YOLOv9 作为目标检测模型来处理雷达图像。

模型优化:为了使本文的模型更加轻量化,本文通过减少原始 YOLOv9 模型中 GELAN 骨干网络 的通道数来减小模型的尺寸。除了最终的检测模块,本文将每个 ELAN 和 CSPnet 模块的通道数减少到原始网络的一半。

问题:由于雷达图像携带的信息量远远低于视觉图像,因此,经过修剪的 YOLOv9 模型 更适合在 GPU 内存有限的情况下使用。

损失函数:本文定义了总损失函数 \( L_C \) 为:

\[ L_C = \lambda_{conf} L_{conf} + \lambda_{coor} L_{coor} \]

其中,\( L_{conf} \) 是置信度损失,\( L_{coor} \) 是坐标损失。总体上,损失函数 \( L_C \) 主要采用 YOLOv9 的损失函数,但进行了两项修改:

- 首先,本文去除了多类别损失和分布焦点损失,因为本文的目标仅是检测人体。

- 其次,本文使用 BCE(二元交叉熵损失)代替 MSE(均方误差损失)来计算 \( L_{coor} \)。

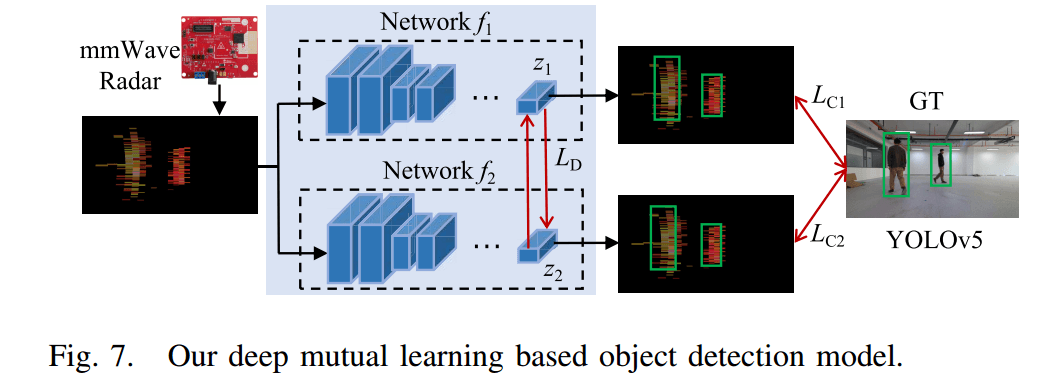

深度互学习框架:为了使修剪后的 YOLOv9 模型更有效,本文利用了 深度互学习(DML)框架。如图 7 所示,本文使用两个 YOLOv9 网络——一个是压缩版本(\( f_1 \)),另一个是原始版本(\( f_2 \)),并通过协同训练来增强适应性。

公式:给定 \( N \) 个样本和两个网络,本文使用 MSE 来量化两个网络预测之间的匹配度。损失函数 \( L_D \) 定义为:

\[ L_D = \sum_{i=1}^{N} || f_1(x_i) – f_2(x_i) ||_2 \]

然后,\( f_1 \) 和 \( f_2 \) 的整体损失函数可以通过以下公式计算:

\[ L_{f_1} = L_{C_1} + L_D \] \[ L_{f_2} = L_{C_2} + L_D \]

其中,\( L_{C_1} \) 和 \( L_{C_2} \) 是监督损失,如公式所定义的。

互学习策略:整个训练过程中应用了互学习策略。在每次迭代中,本文使用 \( f_1 \) 和 \( f_2 \) 计算出的预测结果来更新两个网络的参数。通过这种方式,每个网络不仅学习到如何正确检测目标,还会学习与其对等网络的预测结果相匹配。通过在每次迭代中对齐隐藏特征,两个网络可以实现更好的性能。

应用:在实际应用中,当需要在移动设备或资源受限节点上部署较小的网络时,本文可以选择并利用较小的网络 \( f_1 \) 进行目标检测。

三、实验

1) Experimental Dataset

设备:本文使用了一款 COTS AWR1443BOOST 毫米波雷达(工作频段为 77∼81GHz),并配合 DCA1000EVM 进行实时数据流处理。该雷达的 E-plane 视场角为 120°,H-plane 视场角为 30°,配置为每秒传输 20 帧,每帧包含 240 次 chirps。

相机:本文采用了 Azure Kinect 相机,其 E-plane 视场角为 90°,帧率为 30fps。相机收集 RGB 和深度图像,用于生成地面真实标签(Ground Truth)并进行评估。

同步:本文通过记录的时间戳来同步两个设备。使用雷达帧作为参考,并与 Kinect 时间戳进行最近邻匹配,从而生成配对的雷达、RGB 和深度图像。实验中,本文观察到两个模态之间的最大延迟大约为 0.05 秒。考虑到人体的移动速度,这个延迟在实际场景中是可以接受的。

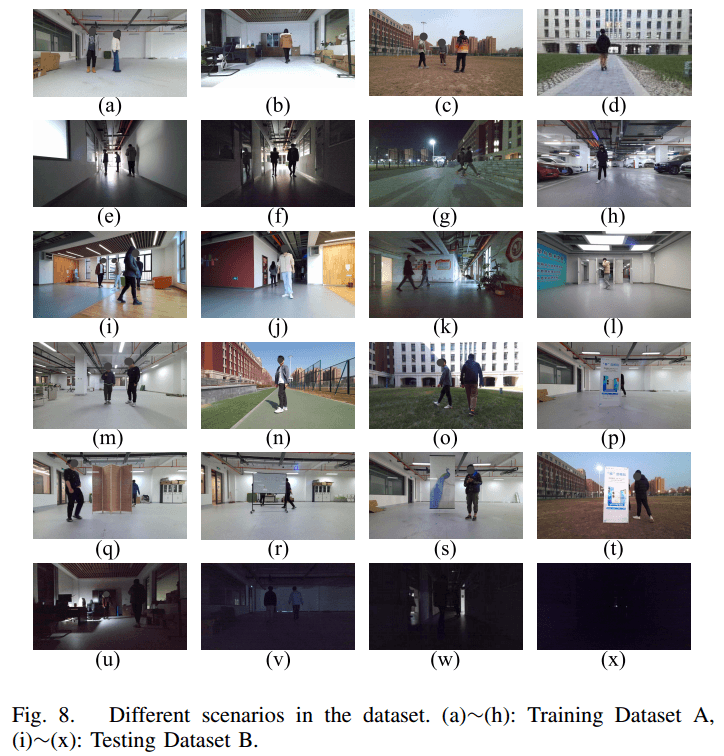

数据集:同步的毫米波和相机数据被收集并构建成数据集。本文邀请了 27 名志愿者(其中 21 名男性,6 名女性)在约 18 个场景中进行行走(1–3 米)(如图 8 所示)。本文的数据集包含 13,848 个样本帧,这些样本被分为两个主要子集。

- 数据集 A 包含 9172 个训练样本,1150 个验证样本,1151 个测试样本,按照 8:1:1 的比例划分,覆盖场景(a)至(h)。

- 数据集 B 包含 2375 个测试样本,涵盖场景(i)至(x)。

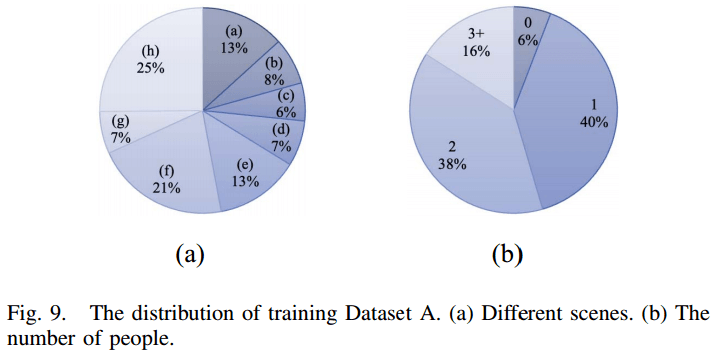

训练数据集 A 的分布如图 9 所示,包含来自 8 个不同地方的帧,每个地方的帧包含 0 到 3 个人。对于测试数据集 B,每个场景包含约 200+ 个样本,每帧随机包含 0 到 3 个人。

地面真实标签生成:本文选择了预训练的 YOLOv5 模型,使用置信度阈值 \( CT = 0.75 \) 和 IoU 阈值 \( 0.45 \) 来生成正常场景中的地面真实标签。对于复杂场景(如场景(k)(p)(r)(w)(x)),本文手动标注边界框以确保准确的标注。

具体来说,对于完全黑暗的场景,本文在深度图像上手动标注人体轮廓;而对于遮挡场景,本文使用辅助相机来帮助标注。

2) DNN Implementation

框架:本文使用 Pytorch 实现了 mmYodar+ 的 DNN 模型,并在 NVIDIA RTX 4090 上训练该模型。

优化器:本文使用了 SGD(随机梯度下降) 作为优化器。

学习率:学习率从 0.01 开始,并逐渐下降至 0.0001,下降速度为 0.0001。

批量大小:每次训练的批量大小为 16。

损失函数参数:在公式(15)中,设置 \( \lambda_{conf} \) 为 0.85,\( \lambda_{coor} \) 为 0.15。

输入尺寸:输入的雷达图像尺寸为 640 × 640 × 3。

NMS 阈值:所有实验的 非极大抑制(NMS) 阈值设置为 0.5。

四、评估

Metric

评估指标:本文使用 平均精度(AP) 作为评估 mmYodar+ 性能的指标。AP 是精度-召回(P-R)曲线下的面积,表示所有精度的平均值。具体来说:

- Precision(精度)= \( \frac{TP}{TP + FP} \),衡量 mmYodar+ 预测结果的准确性。

- Recall(召回率)= \( \frac{TP}{TP + FN} \),衡量 mmYodar+ 能够找到所有正样本的能力。

1) 参数确定和整体性能

IoU 阈值的影响:首先,本文报告了 mmYodar+ 在不同交并比(IoU)阈值下的总体表现。IoU 阈值决定了预测边界框与真实标签框之间的最小重叠部分,超过该阈值后认为检测结果为正确。较高的 IoU 阈值会导致真正例(TP)减少,但可能会引入更多的假阳性(FP)。正如表格 Ⅰ 所示,随着 IoU 阈值的增加,mmYodar+ 的 AP 值逐渐下降,这主要是由于毫米波雷达信号的角分辨率限制和信号稀疏性所致。在 IoU 阈值为 0.5 时,mmYodar+ 在整个数据集(A 和 B)上的平均 AP 为 96.29%。为了在应用中平衡精度和召回率,本文将 IoU 阈值设置为 0.5(这是物体检测模型中的常见设置)。

| IoU | 0.5 | 0.55 | 0.6 | 0.65 | 0.7 | 0.75 |

|---|---|---|---|---|---|---|

| mmYodar+ (A) | 99.45 | 99.39 | 99.09 | 98.32 | 96.90 | 93.66 |

| mmYodar+ (B) | 94.76 | 92.00 | 86.91 | 77.99 | 62.81 | 44.49 |

| mmYodar+ (Ours) | 96.29 | 94.41 | 90.89 | 84.63 | 73.94 | 60.54 |

CT(检测阈值)的影响:表格 II 展示了模型在不同 CT 下的表现。CT 是检测阈值,用于决定预测目标的最小置信度分数,低 CT 值可能会引入更多的假阳性,而较高的 CT 值则可能导致漏检。为了实现精度和召回率之间的平衡,本文将 CT 设置为 0.1,在数据集 A 和 B 上取得了可接受的 AP。

| CT | 0.01 | 0.05 | 0.1 | 0.2 | 0.4 |

|---|---|---|---|---|---|

| mmYodar+ (A) | 99.45 | 99.45 | 99.45 | 99.45 | 99.30 |

| mmYodar+ (B) | 94.82 | 94.84 | 94.76 | 94.46 | 93.80 |

| mmYodar+ (Ours) | 96.33 | 96.34 | 96.29 | 96.09 | 95.60 |

合成帧数对性能的影响:在 mmYodar+ 中,多帧合成能够增强点云对人体的表示能力,但也可能降低检测速度并导致位置偏差。本文评估了不同合成帧数对结果的影响。正如表格 Ⅲ 所示,使用 7 帧组合得到的实验效果最佳,达到了 96.29% 的 AP。

| Composite Frame Numbers | A | B | A+B |

|---|---|---|---|

| 1 | 96.46 | 89.56 | 91.81 |

| 3 | 98.19 | 91.95 | 93.99 |

| 5 | 98.96 | 92.46 | 94.58 |

| 7 (mmYodar+) | 99.45 | 94.76 | 96.29 |

| 9 | 99.45 | 94.08 | 95.83 |

| 11 | 99.48 | 93.08 | 95.17 |

深度互学习(DML)框架的应用:如图 7 所示,mmYodar+ 采用了 DML 策略,使得较小的模型能够从较大的模型中学习。这种方法可以减少模型尺寸,同时保持较大模型的准确性,使其更适合部署在移动设备或资源受限的节点上。

模型性能权衡:表格 IV 展示了 小型模型与 DML 相比大型模型的性能权衡。在较小的网络需要时,DML 方法使压缩后的 YOLOv9t 模型(仅有 0.54M 参数和 2.1G FLOPs)能够实现 94.36% 的 AP,这与较大 YOLOv9t 模型(94.76% AP)非常接近。

| Model | Model Size (M) | FLOPs (G) | B |

|---|---|---|---|

| shrank_YOLOv9t + DML | 0.54 | 2.10 | 94.36 |

| shrank_YOLOv9t | 0.54 | 2.10 | 93.45 |

| YOLOv9t (Ours) | 1.88 | 7.10 | 94.76 |

| YOLOv9s | 7.20 | 26.20 | 94.94 |

| YOLOv9m | 32.60 | 130.70 | 94.40 |

| shrank_YOLOv3 | 7.42 | 22.4 | 92.54 |

2) 消融研究与比较

此表格展示了消融研究的结果,帮助更好地理解 mmYodar+ 中不同设计组件的贡献。可以看出,包含生物特征点选择和带颜色扩展的模型(即 mmYodar+)获得了最佳结果。以下是关键发现:

- 不包含生物特征分析的模型(没有生物特征点选择)接受所有 CFAR 检测峰值用于点云生成,遵循第 III-B3 节介绍的相同点云生成方法。

- 没有生物特征分析时,简单场景(数据集 A)中的性能略有下降,AP 从 99.45% 降至 98.94%。然而,在更复杂的场景(数据集 B)中,性能下降更加明显,AP 从 94.76% 降至 91.78%。

- 与之前的 mmYodar 方法 进行比较时,无论是合成 3 帧还是 7 帧,当前的 mmYodar+ 方法始终优于原始方法。

- 特别是,经过压缩的版本(shrank YOLOv9t + DML),mmYodar+ 实现了模型大小的 20 倍缩减(从 10.22M 降至 0.54M),同时在数据集 B 上提高了 4.76% 的准确度。

与 YOLOv9 的比较:在使用 RGB 和深度图像作为输入时,mmYodar+ 的性能也与 YOLOv9 进行了比较。所有方法在训练场景(数据集 A)中表现相似,但在更具挑战性的场景(数据集 B)中,mmYodar+ 的表现优于 YOLOv9,特别是在遮挡、低光或复杂背景的场景中。这表明 mmYodar+ 在实际应用中更加健壮。

| 模型 | A | B | A+B |

|---|---|---|---|

| mmYodar+ (本文的模型) | 99.45 | 94.76 | 96.29 |

| shrank_YOLOv9t + DML | 99.32 | 94.36 | 95.98 |

| 没有扩展 | 98.80 | 93.93 | 95.52 |

| 没有颜色 | 98.88 | 92.01 | 94.25 |

| 没有扩展且有颜色 | 96.05 | 89.34 | 91.53 |

| 没有生物特征点选择 | 98.94 | 91.78 | 94.12 |

| mmYodar (7 个合成帧) | 98.06 | 89.58 | 91.60 |

| mmYodar (3 个合成帧) | 98.22 | 86.73 | 90.48 |

| YOLOv9 (COCO) | RGB | 99.46 | 78.36 | 85.25 |

| YOLOv9 (COCO, 微调) | RGB | 99.55 | 78.85 | 85.61 |

| YOLOv9 (COCO) | 深度图 | 99.46 | 71.27 | 80.47 |

3) 性能受不同因素影响

不同环境下的性能:无线信号易受不同环境中的环境变化的影响。因此,本文在五个新地点(图8中的场景(i)至(m))评估了系统性能。结果显示,mmYodar+在新环境中表现良好,如表VI所示。

| 环境 | mmYodar+ | YOLOv9 (COCO,fine-tuned) | YOLOv9 (Depth) |

|---|---|---|---|

| New envs | 88.33 | 98.83 | 89.96 |

| Sunlight | 97.73 | 99.43 | 74.56 |

| Dark | 99.24 | 87.41 | 92.98 |

| Pitch black | 96.52 | 0 | 90.46 |

| Occlusion | 76.04 | 26.13 | 15.00 |

差异光照条件:本文还在低光照条件下进行了实验,包括黑暗(图8(u)(v))和漆黑(图8(w)(x))场景,以展示光照条件如何影响系统性能。如表VI所示,mmYodar+分别在黑暗和漆黑场景中获得99.24%和96.52%的AP值,而“YOLOv9 (COCO, fine-tuned)”在黑暗场景中的AP降至87.41%,在漆黑场景中完全失效(AP为0)。

遮挡场景:为了评估mmYodar+在遮挡场景下的性能,本文在室内和室外环境中进行实验,使用了悬挂的屏幕和站立的广告牌等障碍物(图8(p)–(t))。本文使用辅助摄像头收集了障碍物后面的数据,并手动标注了数据。结果显示,尽管AP略有下降,mmWave雷达解决方案在遮挡场景下仍然优于基于摄像头的解决方案。

动作与穿着的影响:本文进一步评估了系统在不同动作下的性能。结果表明,常见的动作如接电话(AP 96.65%)、拿包(AP 94.57%)和拉伸(AP 91.24%)表现较好。然而,随着动作变得更具动态性,系统的准确度有所下降。手势挥动的AP下降至86.15%,奔跑的AP为88.13%。这些结果表明,mmYodar+对于不太动态的动作表现较好,但对于剧烈动作的识别有一定困难。

| 动作 | AP% |

|---|---|

| 接电话 | 96.65 |

| 拿包 | 94.57 |

| 拉伸 | 91.24 |

| 手势挥动 | 86.15 |

| 完全静止站立 | 91.70 |

| 奔跑 | 88.13 |

| 穿厚衣服 | 98.43 |

讨论与结论

系统性能概述:本文的系统利用生物特征信号验证来区分人体目标,使其能够在人员分布较广的情况下有效处理多个人。然而,当人们过于接近时,特别是当他们的点云在方位角维度上重叠时,系统的性能会下降。在这种情况下,系统可能会遇到区分个体的困难,导致检测错误。然而,系统在人员活动稀疏的场景中表现稳定,例如家庭监控、老年人护理和室内安防,这些场景中人与人之间的接触较少,个体通常分散得较开。

mmYodar+ 系统概述:在本文中,本文介绍了mmYodar+,一种创新的系统,利用毫米波雷达在人体检测中的独特优势。本文的系统解决了传统视觉方法的局限性,并在各种真实世界场景中提供可靠和准确的检测。由于本文将毫米波数据转换为雷达图像,系统为基于毫米波的物体检测系统提供了统一的基准,能够采用成熟的基于图像的模型。

未来工作展望:未来的工作可以探索基于融合的方法,进一步扩展系统在更复杂场景中的能力,提升系统的应用范围,特别是在人员密集、复杂环境下的表现。

系统性能概述:本文的系统利用生物特征信号验证来区分人体目标,使其能够在人员分布较广的情况下有效处理多个人。然而,当人们过于接近时,特别是当他们的点云在方位角维度上重叠时,系统的性能会下降。在这种情况下,系统可能会遇到区分个体的困难,导致检测错误。然而,系统在人员活动稀疏的场景中表现稳定,例如家庭监控、老年人护理和室内安防,这些场景中人与人之间的接触较少,个体通常分散得较开。

mmYodar+ 系统概述:在本文中,本文介绍了mmYodar+,一种创新的系统,利用毫米波雷达在人体检测中的独特优势。本文的系统解决了传统视觉方法的局限性,并在各种真实世界场景中提供可靠和准确的检测。由于本文将毫米波数据转换为雷达图像,系统为基于毫米波的物体检测系统提供了统一的基准,能够采用成熟的基于图像的模型。

未来工作展望:未来的工作可以探索基于融合的方法,进一步扩展系统在更复杂场景中的能力,提升系统的应用范围,特别是在人员密集、复杂环境下的表现。